Résumé des actualités :

La plateforme NVIDIA Vera Rubin ouvre la prochaine frontière de l’IA avec :

- Racks (Baies) de GPU Vera Rubin NVL72

- Racks (Baies) de CPU Vera

- Racks (Baies) d’accélérateurs d’inférence NVIDIA Groq 3 LPX

- Racks (Baies) de stockage NVIDIA BlueField-4 STX

- Racks (Baies) NVIDIA Spectrum-6 SPX Ethernet

SAN JOSE, Californie—GTC—16 mars 2026—NVIDIA a annoncé aujourd’hui que la plateforme NVIDIA Vera Rubin ouvre la prochaine frontière de l’IA agentique, avec sept nouvelles puces désormais en pleine production pour faire évoluer les plus grandes usines d’IA au monde.

Cette plateforme regroupe le CPU NVIDIA Vera, le GPU NVIDIA Rubin, le commutateur NVIDIA NVLink™ 6, le NVIDIA ConnectX®-9 SuperNIC, le DPU NVIDIA BlueField®-4 et le commutateur NVIDIA Spectrum™-6 Ethernet, ainsi que le LPU NVIDIA Groq 3 nouvellement intégré. Conçues pour fonctionner ensemble comme un supercalculateur d’IA unique, ces puces alimentent toutes les phases de l’IA, du pré-entraînement à grande échelle, au post-entraînement et à la mise à l’échelle lors de l’inférence (test-time scaling), jusqu’à l’inférence agentique en temps réel.

« Vera Rubin représente un bond générationnel : sept puces révolutionnaires, cinq racks et un supercalculateur géant ont été conçus pour alimenter toutes les phases de l’IA », explique Jensen Huang, fondateur et PDG de NVIDIA. « Le point d’inflexion de l’IA agentique est arrivé avec Vera Rubin qui a donné le coup d’envoi du plus grand projet d’infrastructure de l’histoire. »

« Les entreprises et les développeurs utilisent Claude pour des raisonnements, des workflows agentiques et des décisions critiques de plus en plus complexes. Cela nécessite une infrastructure capable de suivre le rythme », explique Dario Amodei, PDG et cofondateur d’Anthropic. « La plateforme Vera Rubin de NVIDIA nous fournit la puissance de calcul, le réseau et le design des systèmes nécessaires pour continuer à produire des résultats tout en faisant progresser la sécurité et la fiabilité dont nos clients dépendent. »

« L’infrastructure de NVIDIA est le socle qui nous permet de repousser sans cesse les limites de l’IA », explique Sam Altman, PDG d’OpenAI. « Grâce à NVIDIA Vera Rubin, nous allons pouvoir faire tourner des modèles et des agents plus puissants à grande échelle, tout en fournissant des systèmes plus rapides et plus fiables à des centaines de millions de personnes. »

Passage à des systèmes à l’échelle POD

L’infrastructure d’IA évolue rapidement des composants discrets et des serveurs autonomes aux systèmes entièrement intégrés à l’échelle du rack, aux déploiements à l’échelle du POD, aux usines d’IA et à l’IA souveraine. Ces avancées génèrent des gains de performances spectaculaires et améliorent la rentabilité pour les entreprises de toutes tailles et de tous les secteurs (des startups aux PME, en passant par les institutions publiques-privées et les grandes entreprises. Tout en contribuant à démocratiser l’accès à l’IA et à améliorer l’efficacité énergétique pour alimenter les charges de travail les plus exigeantes au monde.

Grâce à une co-conception approfondie du calcul, du réseau et du stockage, soutenue par un écosystème de plus de 80 partenaires de l’écosystème NVIDIA MGX avec une chaîne logistique mondiale, NVIDIA Vera Rubin offre la plateforme à l’échelle du POD la plus étendue à ce jour, : un supercalculateur où plusieurs racks spécialement conçus pour l’IA fonctionnent de concert comme un système unique, massif et cohérent.

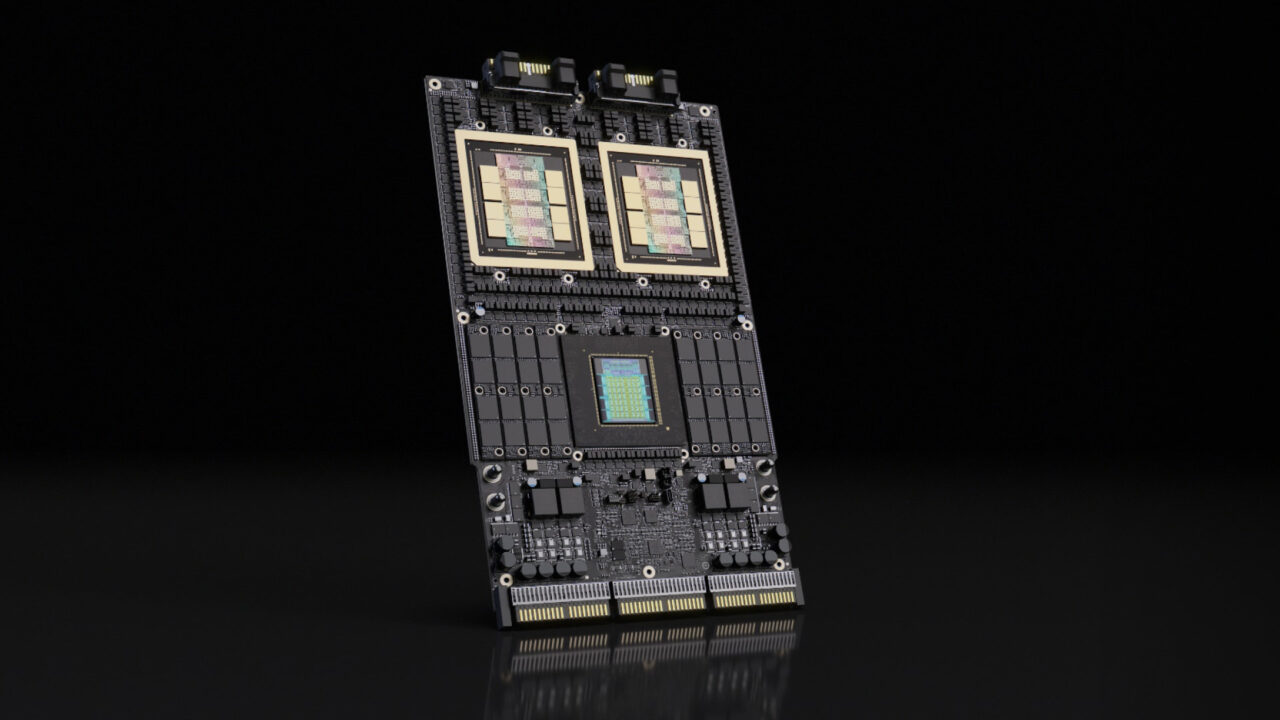

Rack NVIDIA Vera Rubin NVL72

Grâce à l’intégration de 72 GPU Rubin et de 36 CPU Vera connectés par NVLink 6, ainsi qu’aux SuperNICs ConnectX-9 et aux DPU BlueField-4, Vera Rubin NVL72 offre une efficacité révolutionnaire, permettant d’entraîner de grands modèles MoE (mixture-of-experts) avec quatre fois moins de GPU par rapport à la plateforme NVIDIA Blackwell, tout en atteignant un débit d’inférence par watt jusqu’à 10 fois supérieur pour un coût par token divisé par dix.

Conçu pour les usines d’IA hyperscale dans le monde entier, NVL72 s’appuie sur les solutions NVIDIA Quantum-X800 InfiniBand et Spectrum-X Ethernet pour maintenir une utilisation élevée sur des clusters de GPU massifs tout en réduisant les délais d’entraînement et le coût total de possession.

Rack de CPU NVIDIA Vera

Les charges de travail d’apprentissage par renforcement et d’IA agentique s’appuient sur un grand nombre d’environnements basés sur CPU pour tester et valider les résultats générés par les modèles exécutés sur des systèmes GPU.

Le rack de CPU NVIDIA Vera fournit une infrastructure dense à refroidissement liquide basée sur NVIDIA MGX. Il intègre 256 CPU Vera pour fournir une capacité évolutive et écoénergétique avec des performances monothread de pointe, permettant ainsi de libérer tout le potentiel de l’IA agentique à grande échelle.

Intégrés au réseau Spectrum-X Ethernet, les racks de CPU Vera maintiennent une synchronisation étroite des environnements CPU dans l’ensemble de l’usine d’IA. Associés aux racks de calcul GPU, ils constituent la base des CPU pour l’IA agentique et l’apprentissage par renforcement à grande échelle, Vera offrant des résultats deux fois plus efficaces et 50 % plus rapides que les CPU traditionnels.

Rack NVIDIA Groq 3 LPX

NVIDIA Groq 3 LPX marque une étape importante dans le domaine du calcul accéléré. Conçus pour répondre aux exigences de faible latence et de contexte à grande échelle des systèmes agentiques, LPX et Vera Rubin combinent les performances extrêmes des deux processeurs pour fournir un débit d’inférence par mégawatt jusqu’à 35 fois supérieur et des opportunités de revenus jusqu’à 10 fois plus élevées pour les modèles comportant des trillions de paramètres.

À grande échelle, un parc de processeurs LPU fonctionne comme un processeur unique géant pour une accélération rapide et déterministe de l’inférence. Le rack LPX avec 256 processeurs LPU intègre 128 Go de SRAM sur puce et 640 To/s de bande passante scale-up. Déployés avec Vera Rubin NVL72, les GPU et les LPU Rubin boostent le décodage en calculant conjointement chaque couche du modèle d’IA pour chaque token de sortie.

Optimisée pour des modèles à mille milliards de paramètres et un contexte comportant des millions de tokens, l’architecture LPX co-conçue s’associe à Vera Rubin pour maximiser l’efficacité en matière d’énergie, de mémoire et de calcul. Le gain de débit par watt et la performance par token ouvrent la voie à une nouvelle catégorie d’inférence ultra-premium pour les modèles massifs à trillions de paramètres et a des contextes de millions de tokens, ce qui augmente les opportunités de revenus pour tous les fournisseurs d’IA. Entièrement à refroidissement liquide et basé sur l’infrastructure MGX, le LPX s’intègre parfaitement aux usines d’IA de nouvelle génération Vera Rubin qui seront disponibles au second semestre de l’année.

Rack de stockage NVIDIA BlueField-4 STX

Le système à l’échelle du rack NVIDIA BlueField-4 STX est une infrastructure de stockage d’IA native qui étend la mémoire GPU à l’ensemble du POD. Basé sur BlueField-4, qui combine le CPU NVIDIA Vera et le NVIDIA ConnectX-9 SuperNIC, STX fournit une couche partagée à bande passante élevée optimisée pour stocker et récupérer les données massives du cache KV (key-value) générées par les grands modèles de langage et les workflows d’IA agentique.

NVIDIA DOCA Memos™ — un nouveau framework DOCA qui booste le stockage BlueField-4 — permet un traitement dédié du cache KV pour augmenter le débit d’inférence jusqu’à 5 fois tout en améliorant considérablement l’efficacité énergétique par rapport aux architectures de stockage à usage général. Il en résulte un contexte étendu à l’échelle du POD qui permet d’accélérer les interactions multi-tours avec les agents d’IA, des services d’IA plus évolutifs et une utilisation globale plus élevée de l’infrastructure.

« Le système de stockage de mémoire contextuelle à l’échelle du rack NVIDIA BlueField-4 STX apportera le gain de performance critique nécessaire pour passer à l’échelle supérieure nos efforts en matière d’IA agentique », a déclaré Timothée Lacroix, cofondateur et directeur technique de Mistral AI. « En offrant une nouvelle couche de stockage spécialement conçue pour la mémoire des agents d’IA, STX est idéalement positionné pour garantir que nos modèles peuvent maintenir la cohérence et la vitesse du raisonnement sur des jeux de données massifs. »

Rack NVIDIA Spectrum-6 SPX Ethernet

Spectrum-6 SPX Ethernet est conçu pour accélérer le trafic est-ouest dans les usines d’IA. Configurable avec des commutateurs Spectrum-X Ethernet ou NVIDIA Quantum-X800 InfiniBand, il fournit une connectivité rack-to-rack à faible latence et à haut débit à grande échelle.

La technologie Spectrum-X Ethernet Photonics dotée d’optiques co-intégrées offre une efficacité énergétique optique jusqu’à 5 fois supérieure et une résilience 10 fois supérieure par rapport aux émetteurs-récepteurs enfichables traditionnels.

Améliorer la résilience et l’efficacité énergétique

NVIDIA, aux côtés de plus de 200 partenaires d’infrastructure de Data Centers a annoncé le lancement de DSX pour la plateforme Vera Rubin. La nouvelle plateforme DSX inclut DSX Max-Q pour permettre un approvisionnement dynamique en énergie pour l’ensemble de l’usine d’IA, ce qui permet de déployer 30 % d’infrastructure d’IA en plus au sein d’un Data Center à puissance fixe. Le nouveau logiciel DSX Flex permet de transformer les usines d’IA en ressources flexibles pour le réseau électrique, ce qui permet de libérer 100 gigawatts d’énergie jusque-là inexploitée sur le réseau.

NVIDIA a également publié aujourd’hui le design de référence d’usine d’IA Vera Rubin DSX, un modèle d’architecture pour une infrastructure d’IA co-conçue qui maximise le nombre de tokens par watt et le débit utile global, améliorant ainsi la résilience du système et accélérant la mise en production.

En intégrant étroitement le calcul, le réseau, le stockage, l’alimentation et le refroidissement, cette architecture augmente l’efficacité énergétique et garantit une mise à niveau fiable des usines d’IA pour des charges de travail continues à haute intensité, avec une disponibilité maximale.

Prise en charge d’un écosystème étendu

Les produits basés sur Vera Rubin seront disponibles auprès de partenaires à partir du second semestre de l’année. Cela inclut les principaux fournisseurs de Cloud comme Amazon Web Services, Google Cloud, Microsoft Azure et Oracle Cloud Infrastructure, ainsi que les partenaires Cloud de NVIDIA CoreWeave, Crusoe, Lambda, Nebius, Nscale et Together AI.

Les fabricants de systèmes mondiaux Cisco, Dell Technologies, HPE, Lenovo et Supermicro devraient fournir une large gamme de serveurs basés sur les produits Vera Rubin, de même qu’Aivres, ASUS, Foxconn, GIGABYTE, Inventec, Pegatron, Quanta Cloud Technology (QCT), Wistron et Wiwynn.

Les laboratoires d’IA et les développeurs de modèles de pointe, notamment Anthropic, Meta, Mistral AI et OpenAI, prévoient d’utiliser la plateforme NVIDIA Vera Rubin pour entraîner des modèles plus grands et plus performants, ainsi que pour servir des systèmes multimodaux à contexte long avec une latence et un coût inférieurs à ceux des générations de GPU précédentes.