Les Data Centers traditionnels se limitaient essentiellement au stockage, à la récupération et au traitement des données. À l’ère de l’IA générative et agentique, ces infrastructures se sont transformées en usines de production de tokens d’IA. Avec l’inférence IA devenue leur charge de travail principale, leur production essentielle est désormais de l’intelligence, matérialisée sous forme de tokens.

Cette transformation exige un changement correspondant dans la manière d’évaluer l’économie des infrastructures d’IA, y compris le coût total de possession (TCO). Les entreprises qui évaluent des infrastructures d’IA se concentrent encore trop souvent sur les spécifications maximales des puces, le coût du calcul ou le nombre d’opérations en virgule flottante par seconde pour chaque dollar dépensé, autrement dit les FLOPS par dollar.

La distinction qui importe est la suivante :

- Le coût de calcul correspond à ce que les entreprises paient pour leur infrastructure d’IA, qu’elle soit louée auprès de fournisseurs cloud ou détenue sur site.

- Les FLOPS par dollar mesurent la quantité de puissance de calcul brute qu’une entreprise obtient pour chaque dollar dépensé, mais le calcul brut et la production réelle de tokens ne sont pas la même chose.

- Le coût par token correspond au coût global pour une entreprise de produire chaque token délivré, généralement exprimé en coût par million de tokens.

Les deux premières sont de simples métriques d’entrée. Optimiser les inputs alors que l’activité repose sur les outputs constitue un décalage fondamental.

Le coût par jeton détermine la capacité des entreprises à déployer et faire évoluer l’IA de façon rentable. C’est la seule métrique du coût total de possession (TCO) qui prend directement en compte les performances matérielles, l’optimisation logicielle, le support de l’écosystème et l’utilisation réelle — et NVIDIA offre le coût par token le plus bas du secteur.

Quels sont les facteurs qui réduisent le coût par token ?

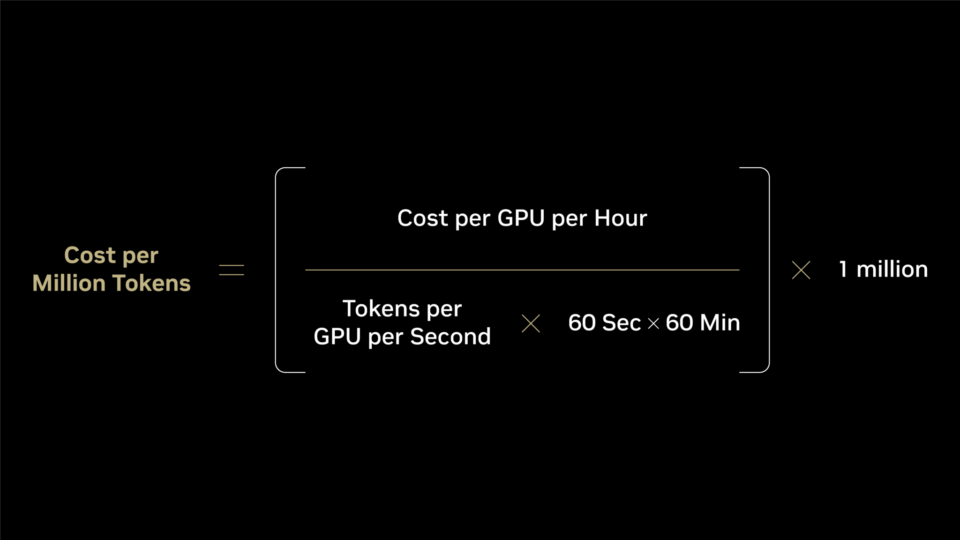

Comprendre comment optimiser le coût par token nécessite d’examiner la formule de calcul du coût par million de jetons.

Dans cette équation, de nombreuses entreprises qui évaluent une infrastructure d’IA se concentrent sur le numérateur : le coût par GPU par heure. Pour les déploiements cloud, il s’agit du tarif horaire payé à un fournisseur cloud ; pour les déploiements sur site, il s’agit du coût horaire effectif obtenu en amortissant l’infrastructure détenue. Cependant, la véritable clé pour réduire le coût par token réside dans le dénominateur : maximiser le volume de tokens produits et délivrés.

Ce dénominateur a deux implications pour l’entreprise.

- Minimiser le coût par token : lorsque cette augmentation du volume de tokens est intégrée dans l’équation de coût, elle fait baisser le coût par token, ce qui augmente la marge bénéficiaire sur chaque interaction traitée.

- Maximiser les revenus : un plus grand nombre de tokens délivrés par seconde se traduit également par davantage de tokens par mégawatt, ce qui signifie plus d’intelligence disponible pour les produits et services basés sur l’IA, et donc davantage de revenus générés à partir du même investissement en infrastructure.

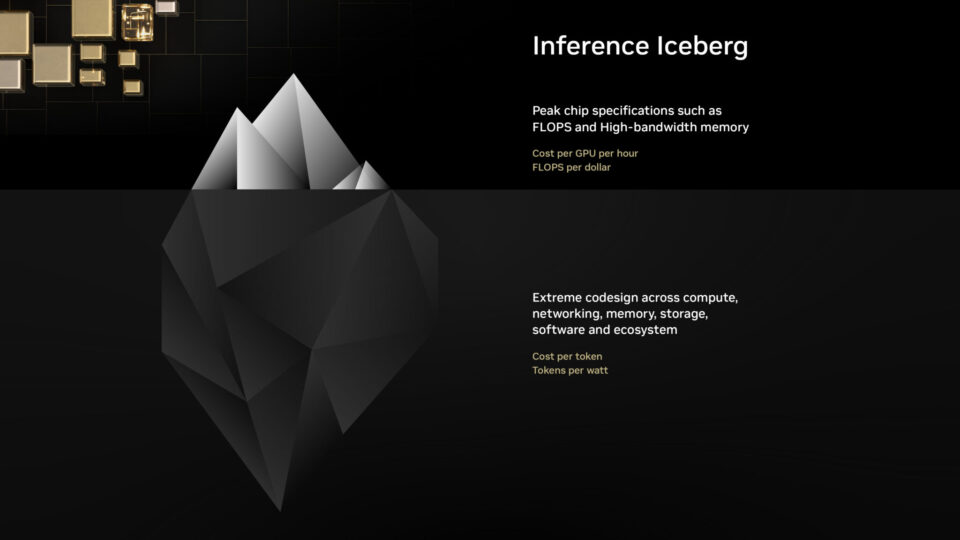

Ainsi, se concentrer uniquement sur le numérateur revient à négliger les facteurs qui alimentent le dénominateur. Considérez-le comme un « iceberg d’inférence » : le numérateur est situé au-dessus de la surface, il est visible et facile à comparer. Le dénominateur est tout ce qui se trouve sous la surface : l’ensemble des facteurs clés qui déterminent la production réelle de tokens. Évaluer correctement une infrastructure d’IA commence par se demander ce qui se cache en dessous.

- Enquête au niveau de la surface :

- Quel est le coût par heure de GPU ?

- Quels sont les pics de pétaflops et la capacité de mémoire à bande passante élevée ?

- Quels sont les FLOPS par dollar ?

- Analyse approfondie des coûts :

- Quel est le coût par million de tokens? Plus précisément, quel est le coût par million de tokens pour les modèles de raisonnement à grande échelle de type mixture-of-experts (MoE), qui représentent le type de modèles d’IA le plus largement déployé ?

- Quelle est le nombre de tokens produits par mégawatt? Pour les déploiements sur site, en particulier lorsque l’engagement en capital pour le foncier, l’énergie et l’infrastructure est important, maximiser l’intelligence produite par mégawatt est essentiel.

- L’interconnexion de mise à l’échelle peut-elle gérer le trafic « all-to-all » des modèles MoE (mixture-of-experts) ?

- La précision FP4 est-elle prise en charge? La pile d’inférence peut-elle utiliser FP4 tout en maintenant une précision élevée ?

- L’environnement d’exécution d’inférence prend-il en charge le décodage spéculatif ou la prédiction multi-tokenspour augmenter l’interactivité des utilisateurs ?

- La couche de serving prend-elle en charge le serving désagrégé, le routage ‘KV-aware’, le déchargement du cache KV et d’autres optimisations ?

- La plateforme prend-elle en charge les exigences de charge de travail uniques de l’IA agentique, notamment une latence ultra-faible, un débit élevé et de grandes longueurs de séquence d’entrée ?

- La plateforme prend-elle en charge l’ensemble du cycle de vie, de l’entraînement et du post-entraînement jusqu’à l’inférence à grande échelle, pour toutes les architectures de modèles, afin de garantir la fongibilité de l’infrastructure et un taux d’utilisation élevé ?

Chacune de ces optimisations algorithmiques, matérielles et logicielles doit être active et intégrée, sous peine de disparition du dénominateur. Un GPU « moins cher » qui fournit considérablement moins de tokens par seconde entraîne un coût par token beaucoup plus élevé. Une infrastructure d’IA qui assure une exécution optimale sur l’ensemble de la pile logicielle et matérielle garantit que chaque optimisation améliore les autres.

Pourquoi le coût par token est-il beaucoup plus important que les FLOPS par dollar ?

Les données suivantes concernant le modèle d’IA DeepSeek-R1 illustrent la différence entre les résultats théoriques et les résultats réels pour l’entreprise.

Si l’on considère le coût de calcul en soi, la plateforme NVIDIA Blackwell semble coûter environ 2 fois plus cher que NVIDIA Hopper, mais le coût de calcul ne dit rien sur le rendement généré par cet investissement. Une analyse de simples FLOPS par dollar suggère un avantage 2 fois supérieur pour NVIDIA Blackwell par rapport à l’architecture NVIDIA Hopper. Cependant, le résultat réel est très différent : Blackwell fournit une production de tokens par watt plus de 50 fois supérieure à celle d’Hopper, ce qui permet d’obtenir un coût par million de tokens presque 35 fois inférieur.

| Métrique |

NVIDIA Hopper (HGX H200) |

NVIDIA Blackwell (GB300 NVL72) |

NVIDIA Blackwell par rapport à Hopper |

| Coût par GPU par heure ($) | 1,41 $ | 2,65 $ | 2x |

| FLOP par dollar (PFLOPS) | 2,8 | 5,6 | 2x |

| Tokens par seconde par GPU | 90 | 6 000 | 65x |

| Tokens par seconde par MW | 54K | 2,8M | 50x |

| Coût par million de tokens ($) | 4,20 $ | 0,12 $ | 35 fois plus bas |

Remarque : les données proviennent de l’analyse NVIDIA et du benchmark SemiAnalysis InferenceX v2.

Cette divergence massive démontre que NVIDIA Blackwell apporte une avancée majeure en termes de valeur économique par rapport à la génération précédente Hopper, dépassant largement toute augmentation du coût des systèmes.

Comment choisir la bonne infrastructure d’IA

La comparaison de l’infrastructure d’IA sur la base du coût de calcul ou des FLOPS théoriques par dollar est non seulement insuffisante, mais elle ne fournit pas une représentation précise de l’économie de l’inférence. Comme le montrent les données, une évaluation précise du potentiel de revenus et de la rentabilité d’une infrastructure d’IA nécessite de passer des métriques d’inputs au coût par token et au volume de tokens effectivement délivrés.

NVIDIA offre le coût par token le plus bas du secteur et le débit de tokens le plus élevé grâce à une co-conception extrême pour le calcul, la mise en réseau, la mémoire, le stockage, les logiciels et les technologies partenaires. En outre, l’optimisation constante des logiciels d’inférence open source tels que vLLM, SGLang, NVIDIA TensorRT-LLM et NVIDIA Dynamo, construits sur la plateforme NVIDIA, permet de faire évoluer l’infrastructure existante : le volume de tokens produits continue d’augmenter tandis que le coût par token continue de diminuer longtemps après son acquisition.

Les principaux fournisseurs de Cloud et les partenaires Cloud de NVIDIA offrent déjà cet avantage à grande échelle. Des partenaires tels que CoreWeave, Nebius, Nscale et Together AI ont déployé l’infrastructure NVIDIA Blackwell et optimisé leurs piles pour offrir aux entreprises le coût par token le plus bas disponible aujourd’hui, avec tous les avantages de la co-conception matérielle, logicielle et de l’écosystème de NVIDIA derrière chaque interaction traitée.